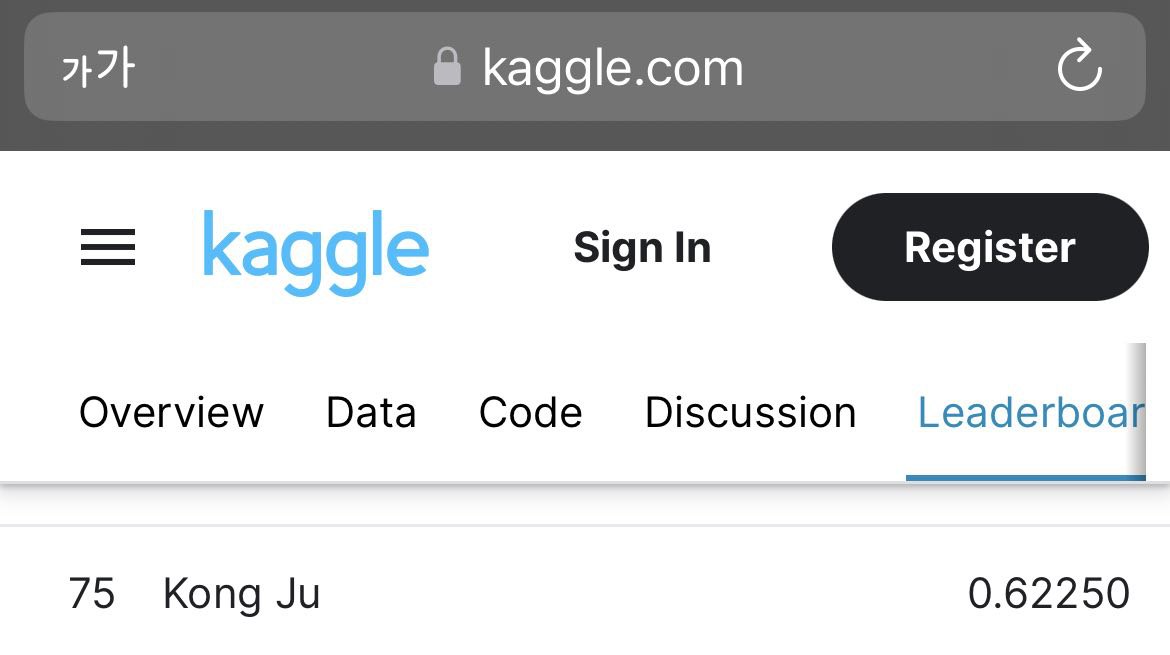

[Diary] 캐글 75위 달성!!

개발 문서와 함께하는 하이퍼파라미터 튜닝

앙상블 모델 중에서 부스팅 기법을 사용하여 분류 문제를 풀고

캐글에 제출하는 과제를 진행했다.

Pipe랑 GridSearchCV를 묶어서 주요 하이퍼파라미터의 최적값을 찾아내고,

XGBoosting 문서를 참고하여

일부 하이퍼파라미터를 계속 수정하는 방식으로 학습을 진행했다.

여러 가지 변경을 시도하였는데 점수가 생각보다 잘 안올라가더라.

일단 제출하고 다시 생각하자 싶어서

Kaggle API를 통해 제출하고 결과를 확인하는데 75위가 나왔다.

어제 Random Forest 기법을 활용했을 때보다 거의 90% 가까이 등수가 올라 기뻤다.

동기들이 내가 제출한 코드를 보고 따라하면 등수는 금방 떨어지겠지만 기쁜 마음에 기록으로 남겨본다.

오늘의 교훈: 개발 문서를 열심히 읽자!

- 제가 참여한 캐글의 순위는 Leaderboard에서 직접 확인할 수 있습니다.